Er du nysgerrig på hvordan du og din virksomhet kan jakte disse mulighetene?

Vi stiller med et tverrfaglig team som guider dere gjennom en strukturert problemløsningsøkt i 2 timer. Konspetet er like enkelt og gøy som det er nyttig og gratis.

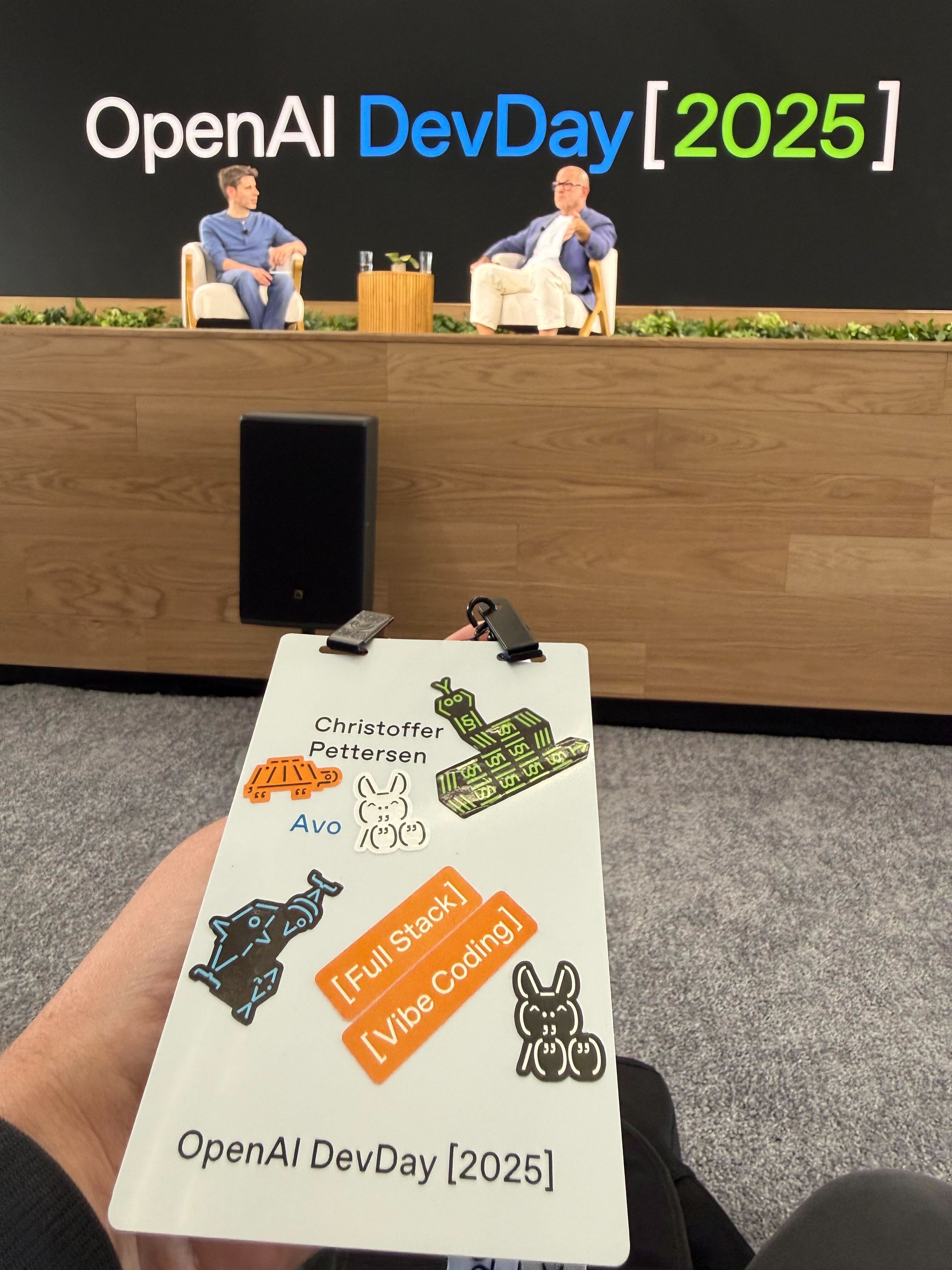

Les Christoffer sine refleksjoner om fremtiden etter OpenAI DevDay [2025]

.png)

Les Christoffer sine refleksjoner om fremtiden etter OpenAI DevDay [2025]

.png)

Er du nysgerrig på hvordan du og din virksomhet kan jakte disse mulighetene?

Vi stiller med et tverrfaglig team som guider dere gjennom en strukturert problemløsningsøkt i 2 timer. Konspetet er like enkelt og gøy som det er nyttig og gratis.

Da Jony Ive, mannen bak iPhone, sto på scenen under OpenAI DevDay 2025 og sa «Unnskyld», var det mange som sperret opp øynene. Han innrømmet det alle egentlig vet: iPhonen ble skapt for å gjøre livet enklere, men endte med å gjøre oss til slaver av teknologien. Nå vil han gjøre det godt igjen. Det neste kapittelet handler ikke om skjermen. Det handler om stemmen.

Vi mennesker har brukt stemmen til å kommunisere siden tidenes morgen. Den er rask, intuitiv og full av følelser. Stemmen bærer tone, rytme og personlighet. Den sier hvem vi er, og hvordan vi har det, lenge før ordene gjør det. Men så kom tastaturet. Og plutselig måtte vi lære oss maskinens språk. Fra rundt 160 ord i minuttet til 40. Enda tregere på mobilen. Det er egentlig bakvendt, for vi har hatt hardware for voice hele tiden: munn og ører.

Nå er vi på vei tilbake dit vi startet. AI har begynt å snakke, og den gjør det ganske bra. Jeg merket det tydelig da jeg var i San Francisco tidligere i høst, på VAPICon, verdens første konferanse dedikert til voice AI. Der sto alt fra OpenAI til små oppstartere på scenen og viste hvordan stemme, følelser og lyd plutselig er i ferd med å bli det nye brukergrensesnittet. Og mens bransjen snakker om neste generasjons stemmeassistenter, går ryktene om at den trolig allerede ligger klar i hånden din: Apple har inngått en avtale med Google. Det betyr at Gemini trolig blir en del av Siri og at Siri 2.0 faktisk kan bli en fungerende AI-agent. Ikke lenger et scriptet svarapparat, men en ekte samtalepartner som forstår kontekst, tone og hensikt.

En voice agent er mer enn en stemmeassistent. Der Siri og Alexa følger forhåndsdefinerte kommandoer, kan en voice agent føre en ekte samtale. Den forstår kontekst, husker hva du sa for to minutter siden, og kan bruke verktøy for å løse oppgaver underveis. Kort sagt: mer Jarvis fra Iron Man enn Siri fra Apple. Bak kulissene skjer dette i to hovedretninger:

Når det er din tur til å snakke i en samtale, er det minst like vanskelig for AI som for oss mennesker. Stopper den deg for tidlig, virker den frekk. Venter den for lenge, føles den treg. De enkleste systemene gjetter basert på stillhet. Men mennesker pauser. Vi trekker pusten, tenker, nøler. Da hopper agenten inn og avbryter.

Nyere modeller prøver å tolke tonefall, tempo og rytme, akkurat som vi gjør. Et lite fall i toneleie eller et roligere tempo kan være signalet på at du er ferdig. Dette fungerer overraskende likt på tvers av språk og kulturer. Som OpenAIs Realtime-API-sjef sa til meg i San Francisco: "Når noen klarer å bygge en modell som virkelig skjønner når det er din tur, får vi et nytt ChatGPT-øyeblikk. Over natten." Kanskje må vi faktisk løse "turn detection" før vi for alvor tar i bruk voice som fremtidens brukergrensesnitt. For dette er jo en brukeropplevelse vi, på tvers av generasjoner, landegrenser og kulturer – allerede kjenner ut og inn.

Når noen klarer å bygge en modell som virkelig skjønner når det er din tur, får vi et nytt ChatGPT-øyeblikk. Over natten.

Etter en dag sammen med noen av de ledende aktørene innen voice og AI i San Francisco, sitter jeg igjen med én klar følelse: Det er ikke lenge før vi får et nytt ChatGPT-øyeblikk. Når det skjer, vil stemmestyrte opplevelser ikke lenger føles som teknologi, men som kommunikasjon; naturlig, flytende og menneskelig. Vi i Avo bygget vår første chatbot i 2017 og vår første voice-løsning i 2021. Nå ser vi momentumet bygge seg opp for fullt, mot det som svært trolig blir både mainstream og fremtidens brukeropplevelse.